Projects 研究プロジェクト

Projects

幼児の知識獲得メカニズムを活用したAI Gaze-based minimal virtual reality paradigm for tracking developing sensitivity to dyadic interactions

構成メンバー

People

- 研究リーダー Project Leader

-

東京大学 国際高等研究所 ニューロインテリジェンス国際研究機構 International Research Center for Neurointelligence (IRCN), The University of Tokyo

Events

Events

- 第9回 Beyond AI 研究推進機構サイエンスカフェ 動画を公開 The 9th Institute for AI and Beyond Science Café Video is now available.

- 研究セミナー 特別回「Building long-term bonds between humans and machines」 Research Seminar "Special Guest Session": Building long-term bonds between humans and machines

- 第35回研究セミナー「乳幼児の言語学習における社会的相互作用の重要性 -双方向視線追跡法の確立-」 The 35th Research Seminar : The Importance of Social Interaction in Infant Language Learning — Establishment of the Two-Way Gaze-Contingent Eye-Tracking Method —

- 第17回研究セミナー「社会的随伴性の学習においての役割」 17th Research Seminar: The role of social contingency on learning

ビデオ

Movie

課題

Challenges

赤ちゃんの驚くべき言語学習能力 The Amazing Language Learning Ability of Babies

赤ちゃんの言語学習は、既存のAIシステムの追従を許さないほどの驚くべき能力です。

AIが人と同じように言葉を操るのはとても難しいことです。その為には、膨大なデータ量と学習コストが必要ですが、人間の赤ちゃんはその成長につれて自然に言葉を話せるようになります。この驚異的な赤ちゃんの言語学習の仕組みを理解し、そのモデルを人工知能に適用することが出来れば、AIを更なるステージに発展させることが出来るはずです。このような脳科学や認知科学などからインスパイアされた古くて新しい人工知能研究アプローチは、未来のAIを担う様々な手法の源泉として改めて世界的に注目を集めていますが、赤ちゃんの言語習得をモデルにしたコンピューターの設計は、この分野でも最先端の取り組みとして注目されています。しかし、この赤ちゃんの驚異的な学習能力の複雑な機序は、今のところ十分に理解されておらず、人工的に模倣することは非常に困難です。

Human infants’ ability to learn language is an amazing skill that is unrivaled by existing AI systems.

In order for AI to learn and use language in the same way as humans do, it requires massive amounts of data. On the other hand, human infants learn to speak naturally as they grow up. Understanding the mechanisms behind infants’ amazing language learning ability and applying these to artificial intelligence models would enable us to take current AI approaches to the next level. Such neuro- and cognitive science inspired approaches to artificial intelligence are once again attracting interest around the world, and among those proposals to design computational models based on how infants’ language acquisition process are spotlighted as cutting-edge initiatives in this area. However, the complex mechanisms underlying infants’ amazing learning abilities have yet to be understood adequately, as they are to date very difficult to imitate artificially.

研究の内容

Details of Project

赤ちゃんの言語習得の謎 The Mystery of Infants’ Language Learning Ability

赤ちゃんはどのようにして、驚くべきスピードと効率で言語を習得しているのでしょうか? 赤ちゃんの素晴らしい学習能力には、母親をはじめとする赤ちゃんの周りの環境、すなわち社会的な環境要素が極めて重要な役割を担っていることが知られています。しかし、それら社会的環境要素が実際にどのように学習に影響を与えているのか、その複雑な仕組みはよく分かっていません。プロジェクトチームは、赤ちゃんの言語習得の仕組み、特に学習における社会的相互作用の役割を理解することで、乳幼児期の言語発達に関する理論構築を目指しています。

So how do babies actually learn a language with such incredible speed and efficiency? It is a known fact that infants’ social environment, for instance the mother, plays a crucial role in the amazing learning skills of babies. However, we have yet to understand the complex mechanism of how such social environmental factors actually influence learning. Our project team aims to establish a theory of early language development by understanding the mechanism of language learning in babies, in particular the role of social interaction in learning.

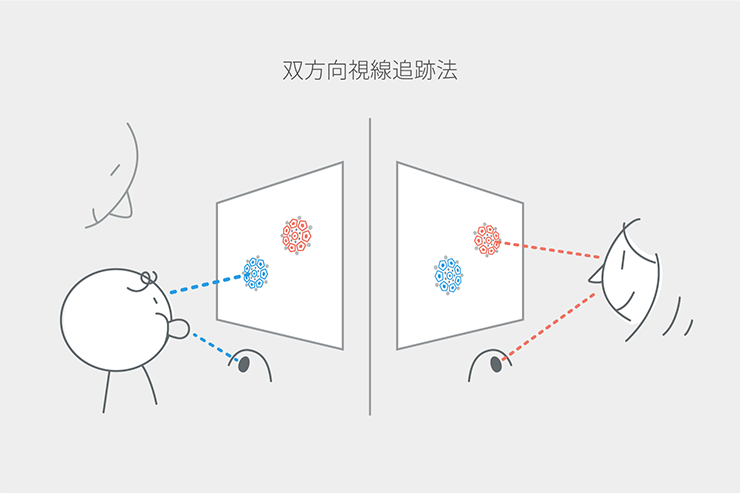

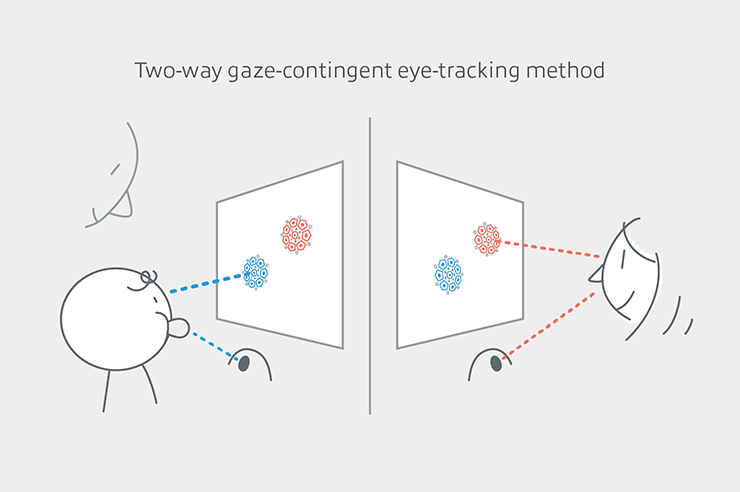

双方向視線追跡法(two-way gaze-contingent eye-tracking method) Two-Way Gaze-Contingent Eye-Tracking Method

本研究では、乳幼児の学習における社会的相互作用の役割を深く理解するために、双方向視線追跡法(two-way gaze-contingent eye-tracking method)に基づいた新たな実験方法を独自に確立します。この双方向視線追跡法は、被験者である赤ちゃんと大人に対し、双方の視線をそれぞれのスクリーン上で互いに追従することでインタラクションを行える実験システムです。この構成によって、二重相互作用が学習に及ぼす影響について、その複雑なダイナミクスを維持しながらも、二次元の管理可能な形態で実験・評価することが可能になりました。また、同一システムで様々な種類の学習シーケンスを評価できる点でも優れています。例えば、このシステムを使うことで、視線誘導による対話的学習と非対話的学習の比較実験を行ったり、クロスモーダルな音と物体の関連付け学習を行ったりといったように、様々な実験が実施可能です。

In this project, we established a unique new experimental method based on two-way gaze-contingent eye-tracking in order to gain an in-depth understanding of the role of social interaction in infant learning. Our experimental system simultaneously tracks the gaze of both the infant participant and an adult interaction partner on their respective screens, thereby recording their gaze interaction. This configuration enables the experimental assessment of the effects of dyadic interaction on learning while maintaining their complex dynamics, but reduced to a two-dimensional manageable format. Moreover, we will be able to evaluate various types of learning sequences with this set-up. For example, we can compare the effect of interactive and non-interactive scenarios, and the effects of such scenarios on learning of cross-modal associations between sounds and objects.

価値・期待

Values / Hopes

本研究プロジェクトが切り開く未来の可能性 Future Possibilities Created by This Project

本研究プロジェクトにより生成された実験データは、乳幼児の言語学習における社会的相互作用のダイナミクスついて明らかにする為の手がかりとなるばかりか、エージェントベースのAIシステムの礎として、インタラクティブなシーケンスの動的特性をモデル化して理解するのに役立つことが期待されています。これによって、将来的には幼児の為の革新的な教育方法を確立したり、ビデオ通話システムのような対話型のデジタルソリューションにも応用したりすることが可能です。

このプロジェクトは、現在のAIの欠点を顕在化し更なる道を切り開く可能性を秘めています。現在の機械学習が独立した学習形態に依存しているのに対し、人間は対話的な学習から能力を獲得します。ここから得られた知見を活用することで、現行の機械学習の更なる発展に寄与するだけでなく、対話的な学習形態をもつ新たなAIの設計に道を切り開く可能性が有ります。

The experimental data generated by this project is expected to not only provide clues for elucidating the dynamics of social interaction in infant language learning but serve as the foundation of agent-based AI systems for modeling and understanding the dynamic characteristics of interactive sequences. Moving forward, it may help establish innovative educational methods for young children and to apply them to interactive digital solutions such as video chat systems.

More speculatively, the unique contribution of this project would be to put the shortcomings of current AI systems into sharper relief: current AI methods rely on decoupled forms of learning, whereas human capacities depend on interactive forms of learning. Accordingly, the project could provide insights that pave the way toward the design of a not only developmentally-inspired, but more interaction-centered form of AI.

成果

Research outcome

本プロジェクトでは、まず乳幼児は非双方向型より双方向型エージェントからよりよく学ぶこと、そして双方向性が乳幼児にとって特に重要な学習の手がかりとなることを立証しました。さらに視線追跡型アイトラッキングを用いて、乳幼児の視線に反応するバーチャルエージェントと反応しないバーチャルエージェントを設計し、それぞれの環境で乳幼児に新しい単語を教えました。

その結果、視線に反応するエージェントから新しい言葉を学ぶことができ、反応しないエージェントからは学べないことがわかりました。この効果は1歳前後で特に顕著であり、年齢が上がるにつれて関連性が薄れていくことも確認しました。

次に、なぜこの双方向性が学習に有効なのか、その背後にあるメカニズムを評価することにしました。乳幼児と実験者が互いの視線の動きを双方で追跡し合うスクリーン上の抽象的なパラダイムを開発し、厳密に制御された実験環境で乳幼児と実験者における双方向性の複雑な動きをリアルタイムに測定できるようにしました。

その結果、乳幼児は画面上のダイナミクスだけで、他の手がかりがなくても、インタラクティブなイベントとそうでないイベントを区別できることがわかりました。

インタラクティブな事象は、より頻繁で長い時間の「出会い」(お互いの視線が追跡し合っている状態)をもたらし、これが社会的学習の優位性の基礎となる潜在的なメカニズムであると考えられます。

今後の研究では、これらの知見を言語学習の成果に結びつけるため、学習効果を最大にするための対話型AIエージェントの設計に向けてこの重要な知見を応用していきます。

In the first part of our project, we established that infants learn better from interactive than non-interactive agents, and that interactivity is an especially important cue for young learners. Using gaze-contingent eye-tracking, we designed a virtual agent that reacted (or did not react) to infants’ gaze, and who taught them new words. Our findings show that young learners are able to learn these new words from the reactive agent, but no the non-reactive agent. We also established that this effect is especially pronounced around the age of 1 year and becomes less relevant with increasing age.

After establishing the importance of interactivity for language learning, the second part of our project sought to assess the mechanisms behind this interactive learning advantage. To this end, we developed a two-way gaze-contingent eye-tracking paradigm, in which infant and experimenter mutually track each other’s eye movements in an abstract, screen-mediated setting. This setup allows to measure the complex dynamics of interaction in real time, but in a tightly controlled experimental settings. We have established that infants can distinguish between interactive and non-interactive events based on the on-screen dynamics alone, and without any other cue to agency. Interactive events lead to more frequent and longer encounters, which is a potential mechanism underlying the social learning advantage.

Future study will link these findings to language learning outcomes, and provide important insights on the design of interactive AI agents for maximizing learning success.

※詳細については、以下のURL(PDF)をご参照ください。

https://beyondai.jp/contents/wp-content/uploads/2023/05/RR_Sho-Tsuji.pdf

※For more detail, please refer to the URL (PDF) below.

https://beyondai.jp/contents/wp-content/uploads/2023/05/RR_Sho-Tsuji.pdf